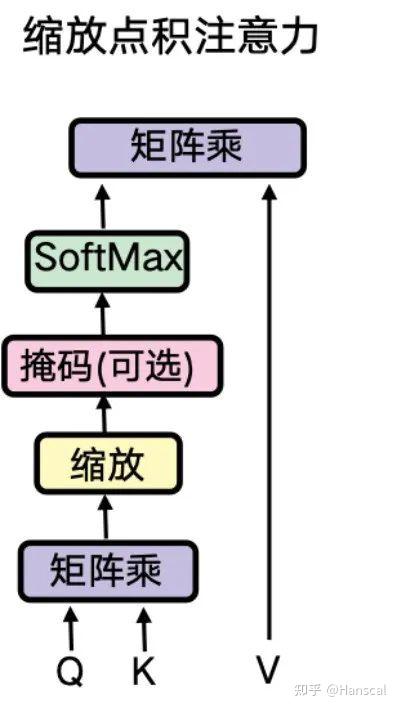

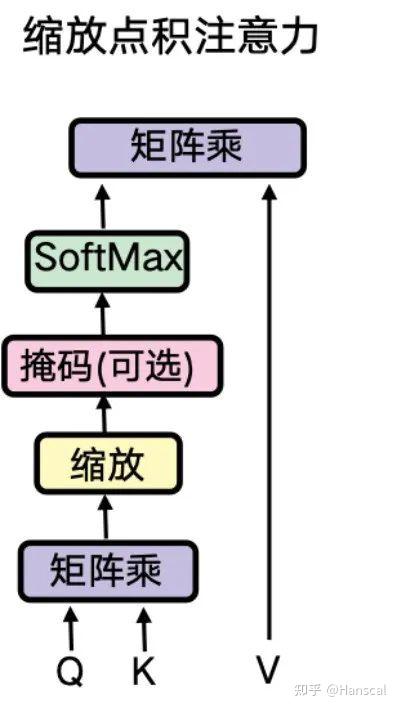

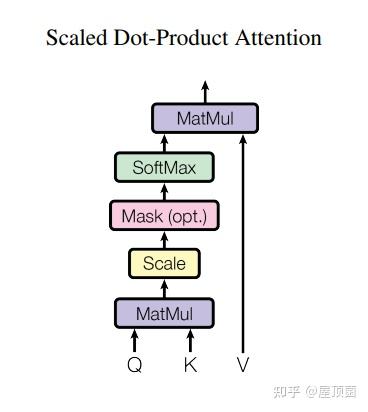

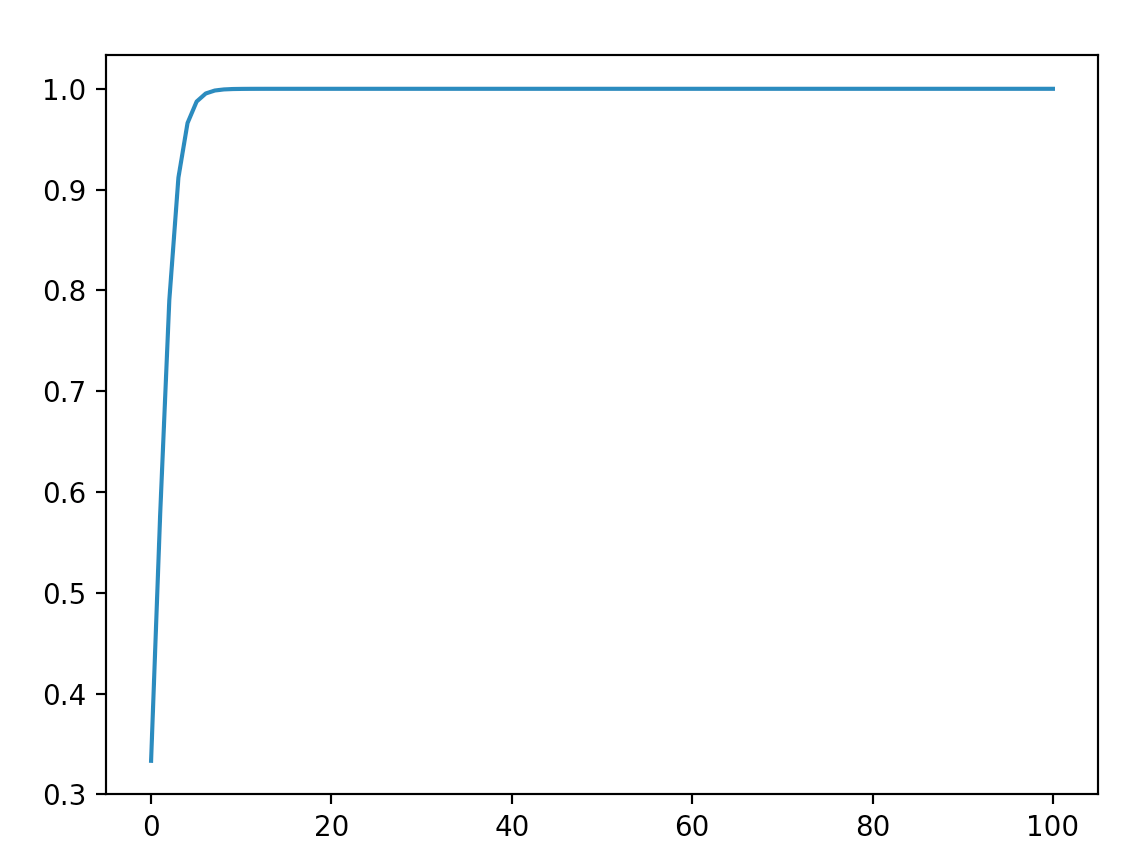

transformer中的attention为什么scaled 知乎

Коллекция transformer中的attention为什么scaled 知乎.

MoE和transformer有什么区别和联系 知乎

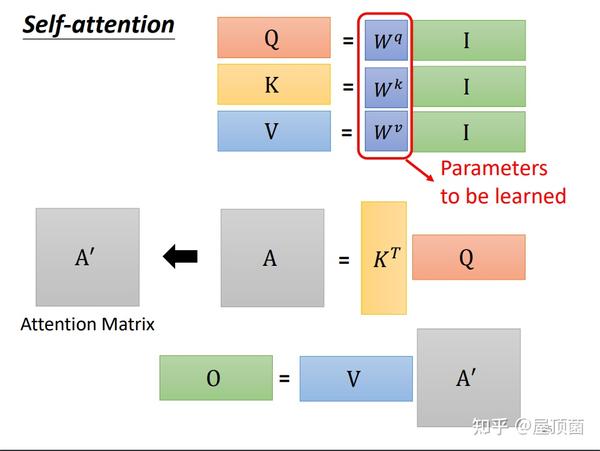

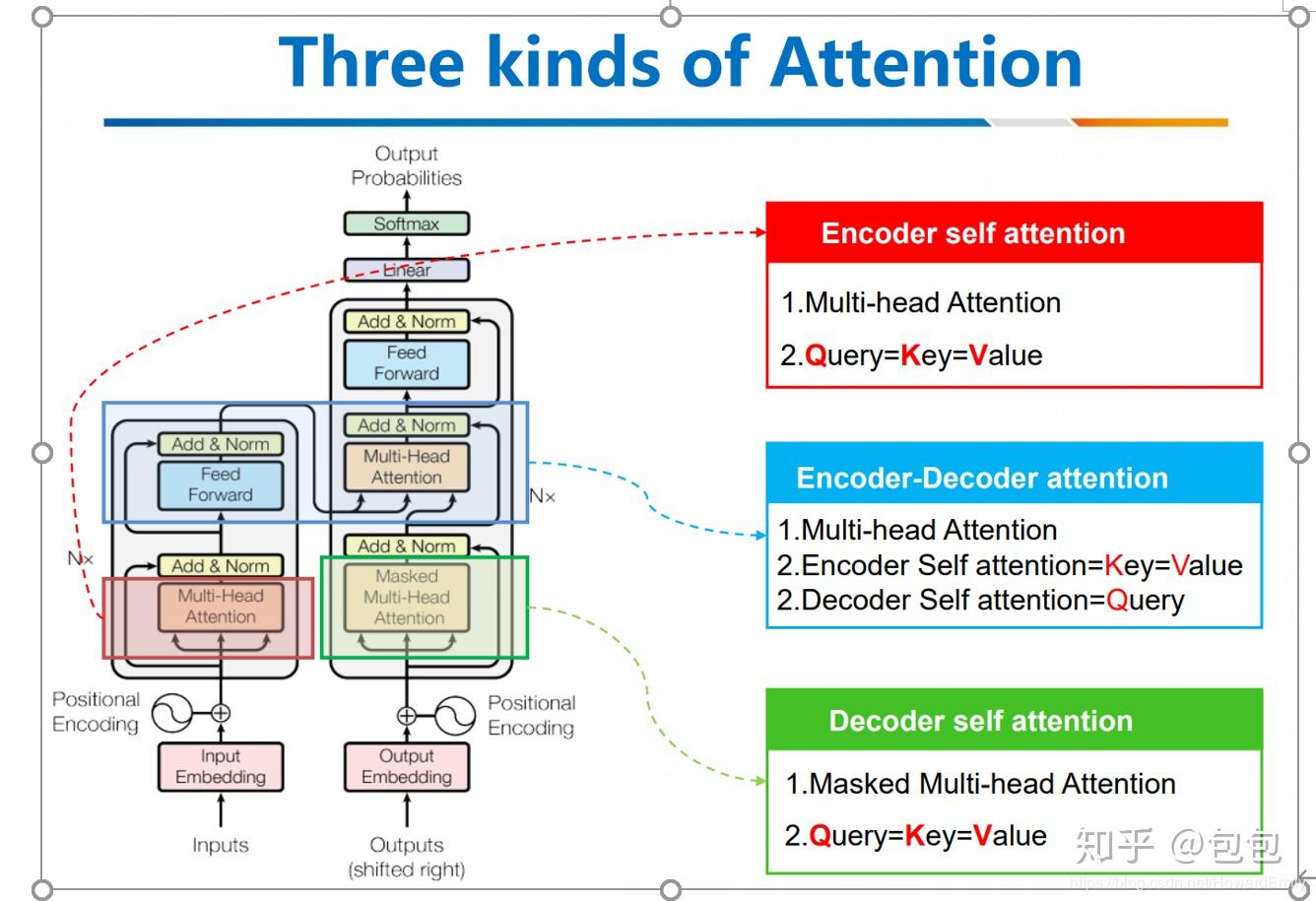

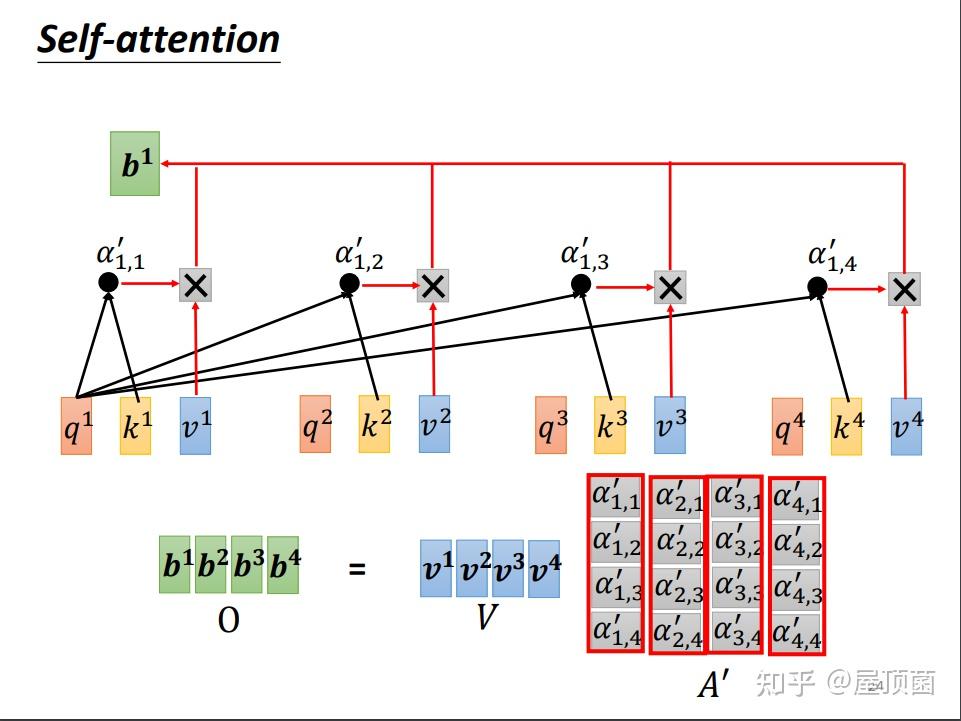

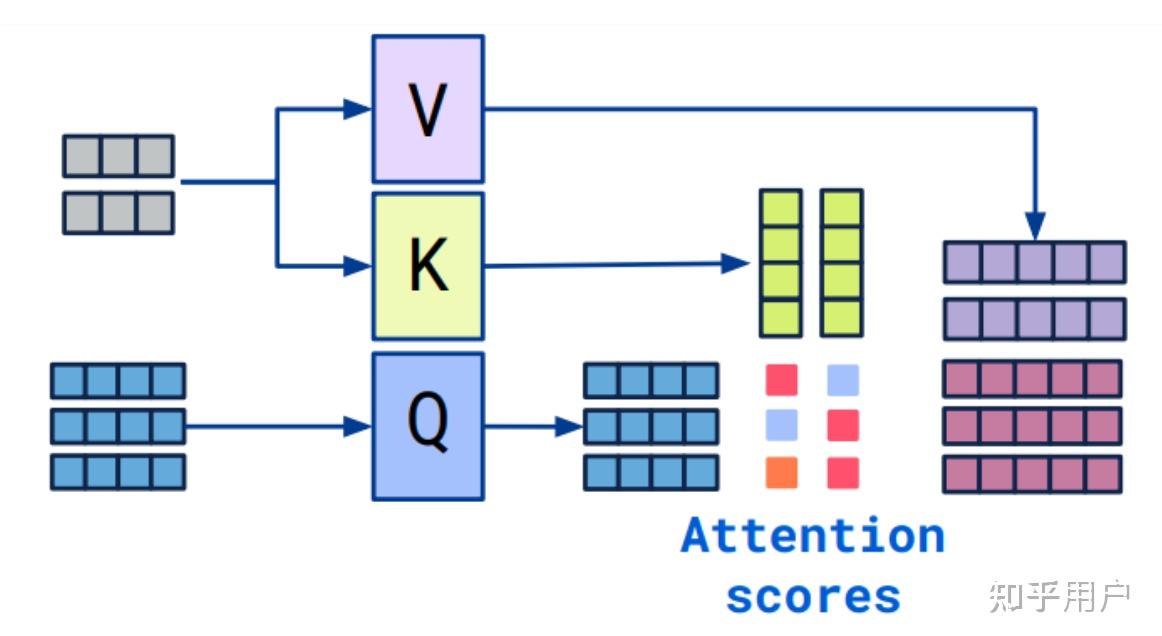

Transformer模型详解图解最完整版 知乎

挑战 Transformer全新架构 Mamba 详解

如何最简单通俗地理解Transformer 知乎

如何从浅入深理解 Transformer 知乎

如何从浅入深理解 Transformer 知乎

Transformer 和 cnn 是两条差异巨大的路径吗 知乎